Устанавливаем AI локально с Ollama

Как легко, быстро и бесплатно установить AI локально на компьютер с помощью Ollama.

Термины и ссылки

Ollama — это приложение, которое поможет установить LLM локально на ваш компьютер, работает под Windows, Linux, MAC.

Ollama автоматически обнаруживает и использует доступные NVIDIA GPU. Убедитесь, что у вас установлены правильные драйверы. Для AMD GPU на Linux требуется ROCm.

Репозиторий Ollama

Установка Ollama

Установка супер-простая: скачиваем и устанавливаем приложение.

Запуск Ollama

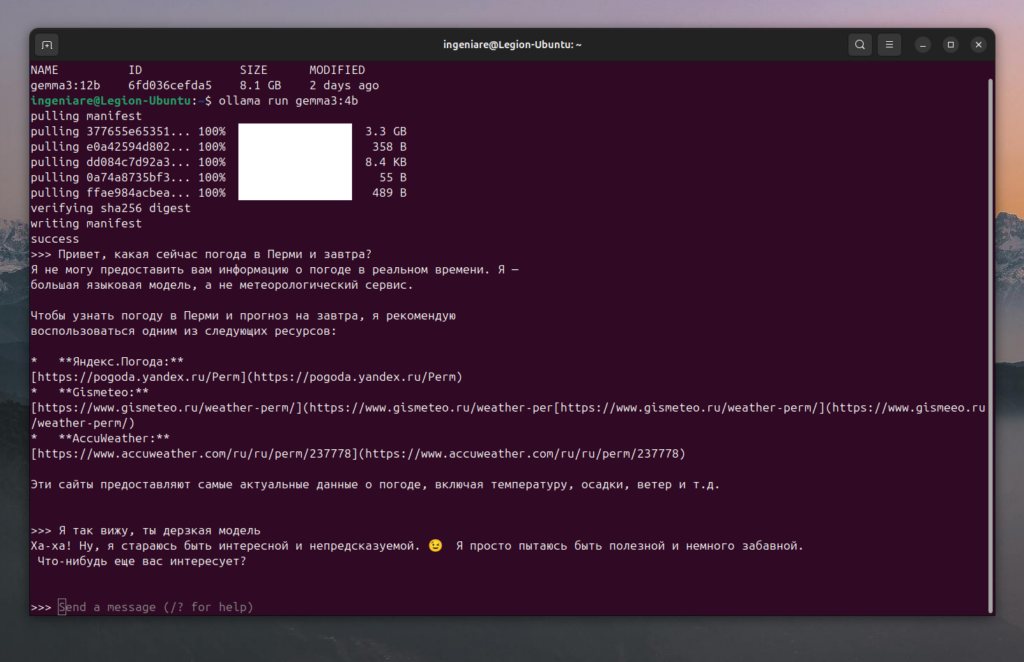

Запуск и скачивание моделей для Ollama происходит через терминал.

Здесь я выбрал Gemma3 с 4 миллиардами параметров — gemma3:4b.

Чтобы скачать и запустить:

ollama run gemma3:4b

И всё, мы уже можем общаться с AI через консоль.

У меня достаточно дерзкая модель попалась, с характером!

Установка только с CPU, через Docker

Если у нас нет хорошей видеокарты GPU, мы можем использовать LLM с процессором CPU. Для этого нам нужно развернуть модель в Docker.

docker run -d -v ollama:/root/.ollama -p 11434:11434 --name ollama ollama/ollama

Если нужна установка через Docker Nvidia или AMD GPU, почитайте документацию.

Обновление Ollama

Ollama на macOS и Windows автоматически загружает обновления. Нажмите на значок на панели задач или в меню, а затем «Перезапустить для обновления».

Комментарии

Обсуждение статьи ведётся в нашем Telegram-канале

Открыть канал